[AI윤리] 고릴라를 금지한 구글포토 수업이야기 -1-

이미지 인식모델로 플라스틱쓰레기와 물고기를 분류하는 체험을 하고 개념을 익힌 다음, 편향을 주제로 인공지능 윤리 수업을 이어갔다.

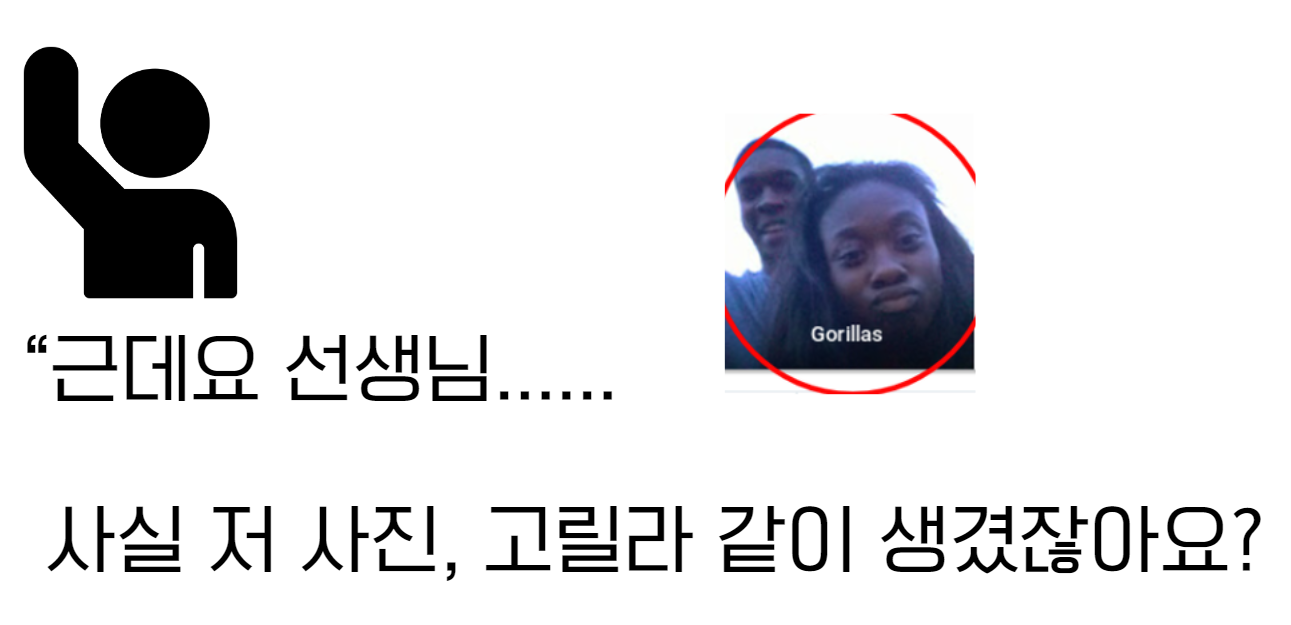

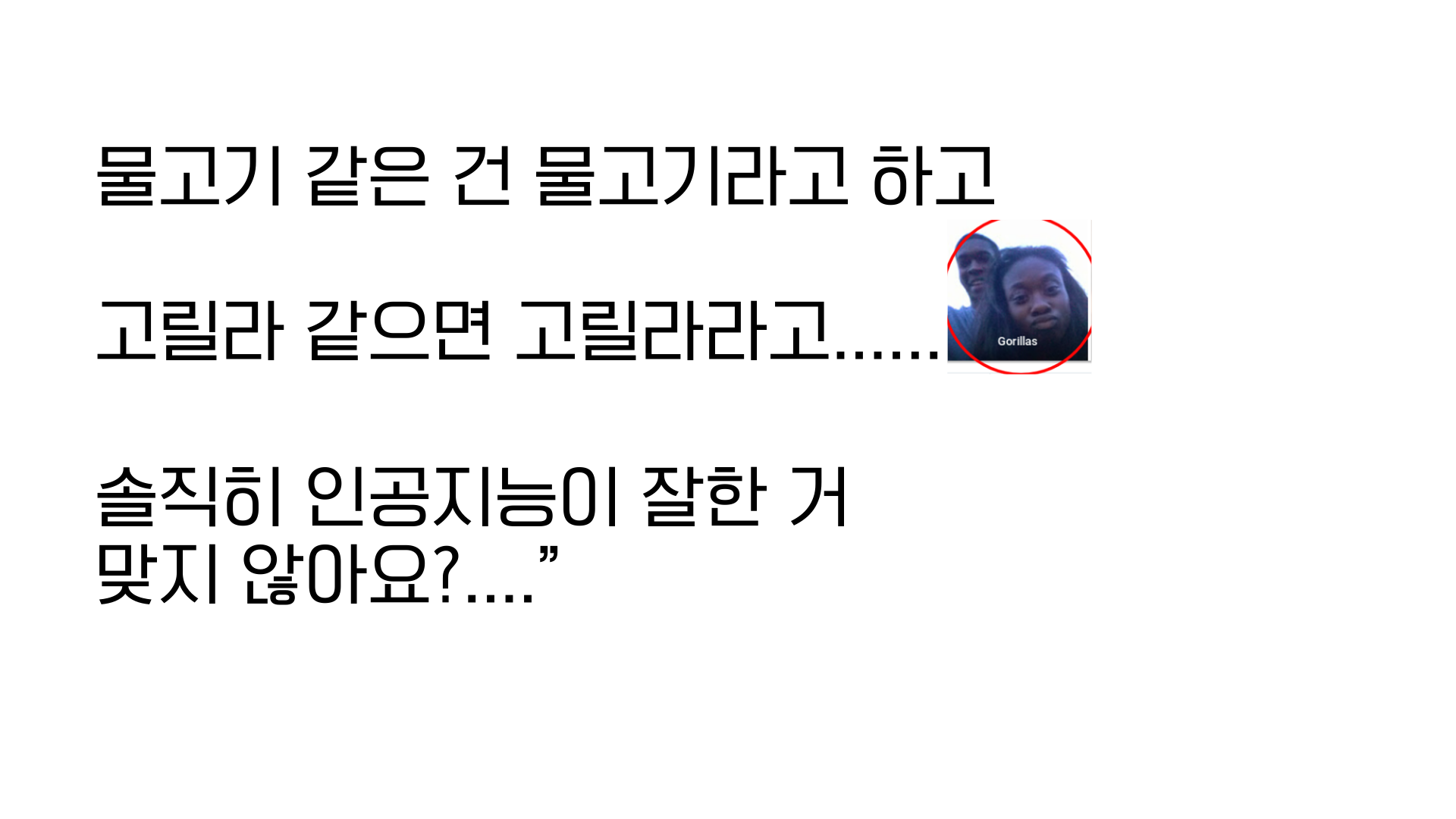

학습된 이미지데이터에 담긴 편향으로 인해, 온도계를 쥔 피부색에 따라 라벨 결과가 총, 온도계 등의 분류가 나타나는 사례, 구글 포토가 흑인의 이미지를 고릴라로 분류한 사례를 제시했다. 즉, 인공지능 윤리의 주제를 '문제를 담은 사례'를 제시하여 소개한 것이다.

같은 수업을 4개 반에서 적용해보았을때도 문제가 없었지만, 딱 1개 반에서 한 남학생이 질문을 했다.

"근데요 선생님.. 사실 저 사진, 고릴라 같이 생겼잖아요?"

당시는 코로나가 심각했던 때라 줌으로 수업을 하던 때다. 확실히 오프라인 수업보다는 집중력이 떨어지는 데다가 점심시간을 막 지난 5교시였으니, 아이들 눈빛이 점점 빛을 잃어가고 있던 때였다.

그런데 저 질문이 나오자 갤러리모드에 나타난 아이들 눈빛이 초롱초롱했다. 모처럼 고개를 드는 아이도 있었다.

"인공지능이 잘 한거 잖아요?"

그 학생은 인공지능 모델이 제대로 작동한 것이라며 말을 덧붙였다.

연수에서 여기까지 이야기하고 나면, 대체적으로 선생님들은 이런 반응을 보이셨다.

"고릴라처럼 보인다고 해도, 사실이라도 그걸 말하는 게 옳은 것은 아니지."

"상대방이 어떤 마음이 들까 생각해야지."

그날 수업에서 나머지 아이들도 똑같은 반응이었다.

5학년 아이들이 자체적으로 바르게 상황을 정리하기 시작했다.

몇몇은 "어떻게 그런 말을 하냐.", 반론의 여지를 주지 않았다.

그러나 그 학생은 딱히 설득되지 않는 모양이었다.

그리고 당황스럽게도 나역시 그랬다.

생각하면 할수록

'인공지능이 잘한 거 맞는데?' 라는 생각이 머리에 맴돌았다.

그친구의 말에 틀린 것이 하나 없었다.

'잘 했는가?'

‘잘’의 뜻은 1) '옳다','바르다'가 될 수도 있고, 2) '정확하다','분명하다'가 될 수도 있다.

자유의지가 없는 인공지능에게 옳고 바른지를 논하지 않을거라면,

그래서 정확하고 분명하게 '잘' 하였는지를 묻는 것이면 '인공지능이 잘 한 것'이 맞았다.

아이들이 '잘한 게 아니지!'라고 정리를 해주는 동안, 그 학생의 질문에 '잘한 거 맞네.'라는 대답만 내 머릿속에 떠올랐다.

결국 안타깝게도 그날 수업에서 나는 굉장히 중요하고도 새로운, 그 간결한 질문에 대답하지 못했다.

나머지 아이들은 적극 나서서 '잘 한 것이 아니지, 인종차별적인 결과잖아. 나쁜 거야.'를 이야기했다.

수업의 끝에 다른 부정적 사례들을 더 제시하면서, 분명 '편향'에 대한 이야기는 잘 전달된 것 같았으나 집에 돌아와서도 내 고민이 끝나지 않았다.

그래서 구글에서 검색을 해보기로 했다.

다음 포스팅에 이어서.